Al tiempo que los gigantes como Google, OpenAI o Amazon compiten por captar la atención y los datos de personas, instituciones y empresas, estas grandes compañías también redefinen el equilibrio de poder. La IA ya no es solo un recurso técnico, sino más bien un vector de transformación que puede impulsar industrias enteras… Aunque también es capaz de destruirlas.

La visión de Empathy.AI plantea construir una IA cuya computación física sucede de forma local y privada. Es decir, una propuesta donde cada institución, empresa, hogar o persona puede disfrutar de experiencias, procesos y soluciones desde una IA que genera, compone, conversa o realiza tareas sin abandonar el espacio de control de sus usuarios. Una IA gobernada por quienes la usan, capaz de funcionar sin recurrir a grandes nubes comerciales y sostenida sobre infraestructuras propias. Una estrategia diseñada para otorgar a las personas y a las organizaciones la soberanía tecnológica que les corresponde.

Para compañías como Empathy.AI del grupo Empathy Holdings, los crecientes costes derivados de computar IA en nubes de terceros como Microsoft, Google o Amazon, se convierten en inversiones y activos cuando las necesarias infraestructuras se instalan dentro de cada organización.

Un sistema inerte sin emociones ni magia

En Empathy.AI parten de una premisa que parece haber sido olvidada en la carrera por impresionar y atemorizar a los usuarios con hipótesis donde la IA no solo es capaz de imitar sino también de superar a las personas: la IA es una máquina, un sistema inerte sin emociones ni instintos, una herramienta descifrable y gobernable.

El CEO y fundador de Empathy Holdings, Ángel Maldonado, lo explica: “Las experiencias de IA que simulan sentimientos o esconden su mecánica de funcionamiento, generan relaciones asimétricas, especialmente peligrosas para personas u organizaciones con bajo conocimiento tecnológico”. Para Maldonado, se trata de una cuestión de confianza. Una confianza que, asegura, no puede construirse sobre sistemas que ocultan cómo funcionan, de dónde extraen sus datos o qué uso hacen después de ellos.

“Las experiencias de IA que simulan sentimientos generan relaciones asimétricas, peligrosas para personas u organizaciones con bajo conocimiento tecnológico”

Ese es, en su opinión, el punto ciego del modelo dominante que coloca a la IA en una posición distante e inalcanzable al menos que nos rindamos a los grandes proveedores. “OpenAI o Google dependen de atraer usuarios, recopilar sus datos y captar su atención; en última instancia, convierten al individuo en un medio para alimentar sus propios objetivos”, explica. Ese planteamiento, dice, genera relaciones desequilibradas y condiciona a organizaciones que podrían acabar tomando decisiones estratégicas basadas en plataformas cuyos incentivos no son los suyos.

Para él, no se trata solo de un dilema técnico o jurídico, sino de un cambio profundo en la forma en que las personas y las instituciones se relacionan con la tecnología. La IA se ha vuelto un intermediario invisible entre la información y quienes la utilizan, y esa intermediación si no es transparente puede llegar a erosionar la autonomía de empresas enteras. De ahí la importancia de recuperar soberanía. “Una IA auténticamente privada, sostenible y que no dependa de vender ni explotar los datos de sus clientes y usuarios es una tecnología sin ataduras, capaz de crecer sin comprometer su integridad ni la de quienes la utilizan”, afirma.

Su propuesta es, por lo tanto, muy distinta al camino que siguen los modelos conversacionales populares. Empathy.AI apuesta por transparencia, claridad y una comunicación que no imite comportamientos humanos. De hecho, todas sus experiencias de IA incluyen acceso al Master Prompt, un espacio donde se explican los principios que rigen la herramienta, su procedencia y sus límites.

“Como se puede constatar, por ejemplo, en experiencias IA como la de la Casa Del Libro (‘Truman’), Empathy.AI expone con claridad cuáles son los principios que rigen el valor de Empathy.AI”, señala. El objetivo es que el usuario sepa exactamente qué puede esperar de la IA y qué no; qué hace, cómo funciona y por qué.

Este enfoque coloca a Empathy.AI en un lugar muy distinto al de las grandes tecnológicas. Su ambición es garantizar que cada organización que adopta su tecnología lo hace desde un marco de control total sobre sus datos y sobre los mecanismos que generan las respuestas de IA.

Una infraestructura privada y eficiente

Uno de los rasgos más singulares de Empathy.AI (y una diferencia estructural con respecto a la IA comercial tradicional) es que funciona íntegramente sobre una infraestructura privada. No se conectan a Amazon Web Services, ni a Google Cloud, ni a Azure, ni dependen de modelos remotos de OpenAI o de otros proveedores. La computación ocurre en un entorno diseñado, gestionado y auditado por ellos.

“Creamos nuestra propia infraestructura privada de gran formato sobre Graphical Processing Units (GPUs), concretamente H200s, tanto a gran escala para dar servicio a más de 3.000 empresas, como para dar servicio interno a nuestros equipos mediante supercomputadores locales (DGX Spark), lo que garantiza que el capital para innovar con IA demanda es contabilizado como una inversión y no un coste.

Por poner un ejemplo, el coste operacional (OPEX) de dar herramientas de IA a más de 100 empleados como Perplexity, Cursor, Co-Pilot o GPT excede los 200.000 euros al año, un coste que se multiplica año a año al tiempo que la propiedad intelectual fluye al exterior. Sin embargo, disponer, configurar, evolucionar y mantener 20 supercomputadores de uso interno no supera los 50.000 euros”, explica Maldonado. Un planteamiento que sintetiza una filosofía de carácter tecnológico que pretende combatir la tendencia global a externalizar toda la computación crítica. Sumado a esta ventaja, muchas empresas, hospitales, instituciones educativas o firmas legales, trabajar con IA significa enviar información hacia plataformas que pueden almacenarla, reutilizarla o, como mínimo, analizarla. Eso, para Ángel, compromete la capacidad de las organizaciones para diferenciarse y proteger aquello que constituye su valor.

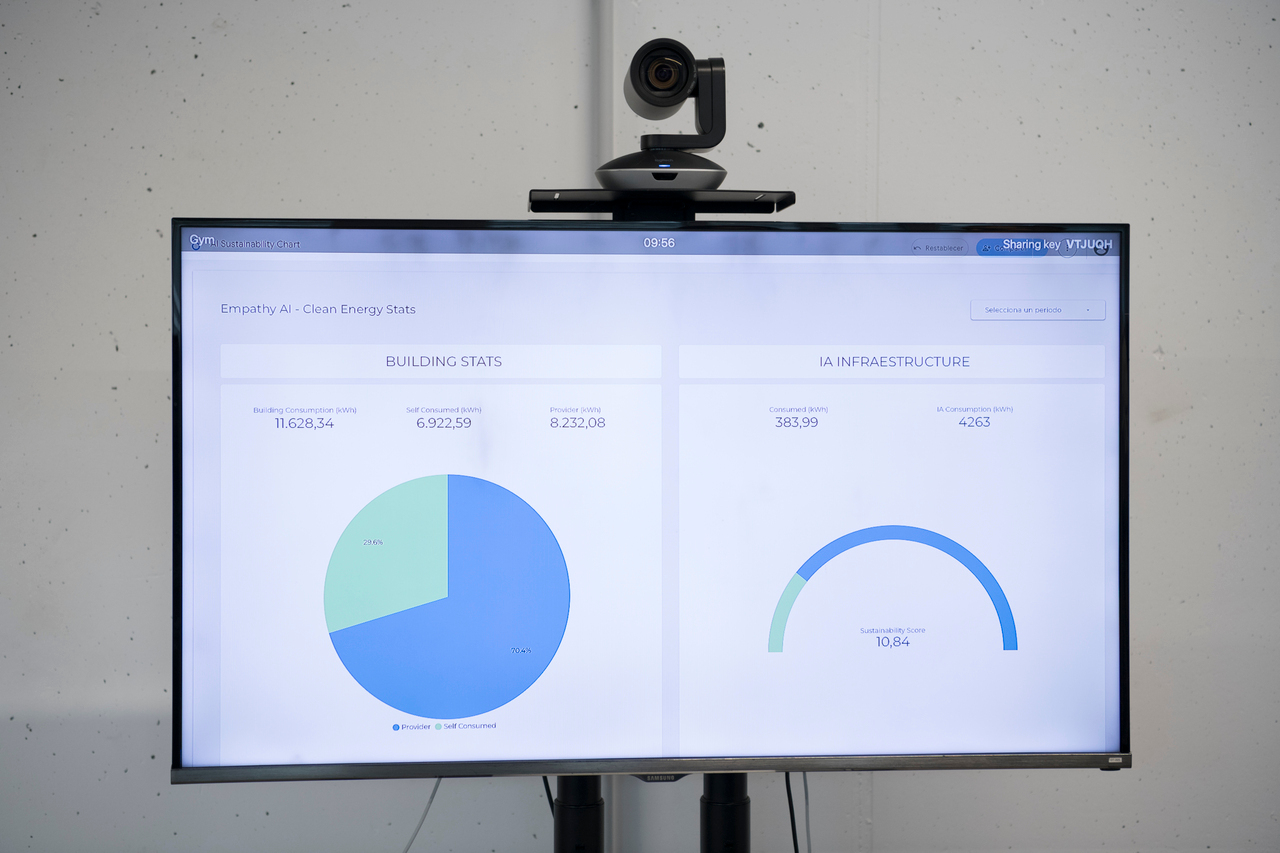

El desarrollo de una infraestructura propia responde también a otra preocupación: la eficiencia. Empathy.AI busca cubrir “un 10% del consumo de una creciente base de más de 20 GPUs". Según explica, sus modelos permiten reducir el uso de recursos computacionales en más del 90% frente a la IA tradicional.

“La sostenibilidad es prioritaria porque la IA tradicional consume grandes cantidades de energía, generando impacto ambiental y coste social”, afirma. Esa visión enlaza directamente con otro de los pilares de la compañía: la responsabilidad ambiental.

Y es que desde Empathy.AI insisten en un aspecto que suele quedar fuera del discurso mainstream sobre IA: el coste energético real de la computación. Las instalaciones fotovoltaicas que alimentan parte de su infraestructura son un reflejo de esa preocupación por ejecutar la IA sobre un sistema más equilibrado y menos dependiente de fuentes externas.

“La sostenibilidad es prioritaria porque la IA tradicional consume grandes cantidades de energía, generando impacto ambiental y coste social”

En su visión, la sostenibilidad no es un añadido opcional, sino una condición para asegurar que el crecimiento de la IA no derive en un aumento desproporcionado del consumo energético. Por eso la instalación fotovoltaica no es un gesto simbólico: forma parte de un ecosistema tecnológico que busca cerrar el círculo ético, operativo y ambiental.

Integrar producción de energía renovable con infraestructura privada de GPUs refuerza esa idea de soberanía completa: de los datos, de la computación y también de la energía que los sostiene. Es un enfoque poco común en el sector, donde la mayoría de las empresas dependen de centros de datos remotos cuya huella energética queda fuera de su control.

Aplicaciones reales

Aunque su aproximación es ética y estructural, Empathy.AI tiene aplicaciones muy tangibles que ya están operativas en distintos ámbitos. Maldonado destaca tres líneas de trabajo que ilustran bien cómo se traduce esta filosofía en experiencias concretas que usan miles de personas sin ser conscientes de que detrás hay un modelo de IA privado y eficiente.

Por un lado, está la colaboración con Project Gutenberg, una de las colecciones digitales más amplias del mundo. Gracias a Empathy.AI, cualquier usuario puede dialogar con más de 75.000 libros, formulando preguntas, buscando conexiones temáticas o explorando obras completas sin necesidad de comprender cómo funciona el sistema. La IA actúa como un puente amable entre la literatura y el lector, sin apropiarse de los datos de uso ni registrar comportamientos. Es un ejemplo claro de cómo una IA privada puede enriquecer la experiencia cultural sin interferir en ella.

Otra de las aplicaciones más relevantes se encuentra en el ámbito industrial. En su trabajo con BOSCH, Empathy.AI ha desarrollado una herramienta que facilita la conexión entre problemas reales detectados por técnicos o usuarios y la información técnica contenida en manuales y documentación corporativa. En lugar de navegar por miles de páginas o manuales PDF, la IA permite que un profesional formule una pregunta concreta y obtenga la parte exacta del material que necesita. El valor aquí no es solo la rapidez, sino la fiabilidad: la herramienta opera sobre datos que la organización controla y valida, sin riesgo de que la información sensible viaje a plataformas externas.

También destaca su papel en el comercio y el sector editorial a través de ‘Truman’, la experiencia de búsqueda conversacional para La Casa del Libro. En este caso, el sistema permite hablar sobre libros con naturalidad, expresar dudas, pedir recomendaciones o explorar autores sin necesidad de formular consultas técnicas. Todo ello respetando la privacidad del lector y sin utilizar ningún modelo externo que almacene preferencias, historiales o hábitos de lectura. Truman demuestra que la IA puede ser cercana sin simular emociones y útil sin comprometer la intimidad de quien la usa. Para Maldonado, este es un buen ejemplo de que una IA diseñada para estar al servicio de la inteligencia humana puede integrarse en sectores muy distintos sin renunciar a sus principios.

Estas experiencias tienen algo en común: se apoyan en infraestructura propia, funcionan con modelos optimizados que consumen menos energía y están guiadas por un marco ético claro.

Innovación tecnológica desde Asturias

Construir computación de Inteligencia Artificial desde Asturias forma parte de una apuesta estratégica. Maldonado lo explica con claridad: “Asturias, como cualquier otra región, no debe someterse al control de un puñado de nubes y modelos comerciales gobernados por países desinteresados con Asturias”. Crear tecnología local significa preservar la identidad, desarrollar tejido económico y reducir la dependencia digital.

Además, insiste en algo relevante: Empathy.AI “no cuenta con ningún apoyo institucional o gubernativo”. Es un proyecto privado que se sostiene exclusivamente con su éxito empresarial y con la defensa de un modelo tecnológico alternativo.

Lo que buscan, en última instancia, es demostrar que es posible desarrollar tecnología puntera fuera de los grandes polos globales y sin replicar sus modelos extractivos.

Sobre el futuro, el fundador de Empathy es directo: la nube, tal como la conocemos, está a punto de fragmentarse. “Se está condensando hasta tal punto que veremos una auténtica lluvia de descentralización”, afirma. En ese escenario, cada organización, e incluso cada hogar, tendrá su propia IA, del mismo modo que en los años 90 comenzó la democratización del ordenador personal.

Su visión es la de un ecosistema distribuido en el que la IA no sea un servicio remoto, sino una herramienta propia de cada usuario. Un recurso cotidiano, íntimo y controlado localmente.

Pero Ángel identifica un desafío mayor que la competencia tecnológica, que no es otro que el de educar a las personas en el funcionamiento real de la IA. “El instinto, la intención o los sentimientos no serán nunca replicables”, sostiene. Para él, la clave no está en la potencia de cálculo, sino en la alfabetización tecnológica que permita a la sociedad tomar decisiones informadas.

“Antropomorfizar sistemas, objetos o creaciones es una tendencia irresistible”, reconoce. El reto, dice, es hacer ver que la IA es una cosa. Desde su punto de vista, sólo si se comprende su naturaleza mecánica podremos usarla sin caer en ilusiones peligrosas ni en dependencias invisibles.

En definitiva, Empathy.AI no pretende competir con los grandes modelos globales ni participar en la carrera por crear inteligencias cada vez más grandes y más imitativas del ser humano. Su apuesta es otra: privacidad, sostenibilidad, transparencia y soberanía. Una IA diseñada para amplificar la inteligencia humana sin sustituirla, construida desde la convicción de que la tecnología debe respetar a quienes la utilizan y no convertirlos en un recurso. Así pues, proponen un camino distinto en el que la IA es una máquina que puede convertirse en una extraordinaria aliada siempre que se diseñe desde el respeto, la transparencia y el control de sus usuarios.